Yazıyı okuyorsunuz: MinD-Vis AI modeli, beyin aktivitesine dayalı olarak insanların zihinlerini okuyabilir

MinD-Vis adı verilen yeni bir yapay zeka modeli, bir kişinin gördüklerini beyin aktivitesine göre yorumlayabiliyor. Model, kişi bir nesneyi gördüğünde beyinde mevcut olan ‘anımsatıcı değişmezleri’ yorumlayarak çalışıyor. Bu anımsatıcı değişmezler, aynı nesnenin farklı anılarında saklanan kalıplardır.

Beyin aktivitesinin küresel yerleşimlerini elde etmek için yazarlar önce kendi kendini denetleyen bir model geliştirdiler (farklı insanlar için aynısı). Daha sonra bu zihinsel temsillere çapraz dikkati kullanarak gizli difüzyon. Model, 1,5k görüntü üzerinde yapılan hızlı bir ayarlamanın ardından kişinin karşısında ne gördüğünü tamamen çözebildi.fMRI akranlar!

İnsanın görsel sistemini daha iyi anlamak ve beyin-bilgisayar arayüzü aracılığıyla insan ve bilgisayar görüşü arasında köprü kurmak için temel sağlamak amacıyla, beyin kayıtlarından görsel uyaranların kodunun çözülmesi, görsel sisteme dair anlayışımızı genişletmeye çalışır. Beyin sinyallerinin altında yatan temsillerin karmaşıklığı ve veri açıklamalarının azlığı, beyin kayıtlarından yüksek kalitede doğru görüntülerin yeniden oluşturulmasını zorlaştırıyor.

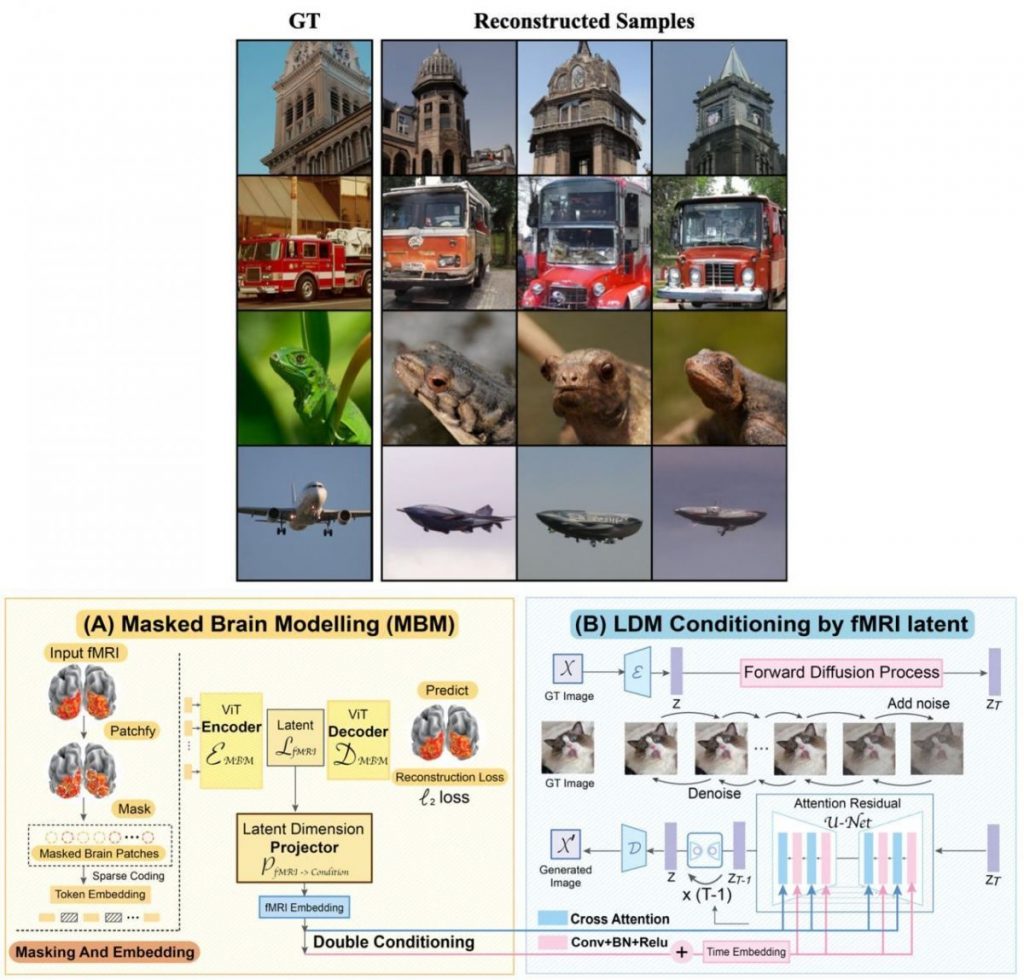

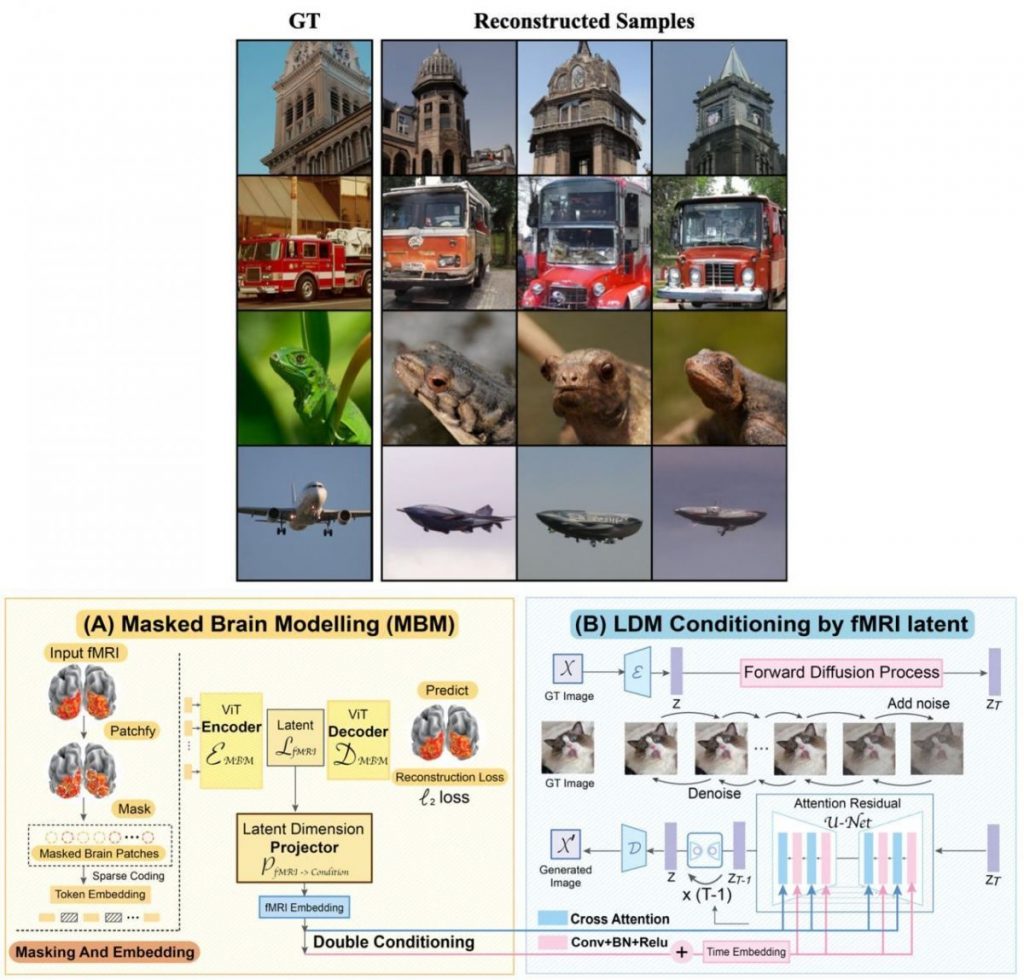

İlk olarak, birincil görsel korteksteki seyrek bilgi kodlamasından ilham alan oldukça büyük bir gizli alanda maske modellemeyi kullanarak, fMRI verilerinin kendi kendini denetleyen etkili bir temsilini oluşturduk. Daha sonra MinD-Vis’in, gizli bir yayılma modeline çift koşullandırma ekleyerek minimum sayıda eşleştirilmiş açıklama kullanarak beyin kayıtlarından semantik olarak eşleşen ayrıntılarla son derece güvenilir görüntüleri yeniden oluşturabildiğini gösterdik.

Araştırmacılar belirtti

Deneysel sonuçlara göre strateji, anlamsal haritalama (100 yollu anlamsal sınıflandırma) ve üretim kalitesinde (FID) en son teknolojiyi sırasıyla %66 ve %41 oranında geride bıraktı. Model hem niteliksel hem de niceliksel olarak değerlendirilmiştir. Çerçeveyi değerlendirmek için ablasyon üzerine kapsamlı bir çalışma da yapıldı.

Eğitim verileri, kod ve model ağırlıkları şu adreste kamuya açıktır: emir.

Araştırmacılar, modelin kör veya az gören kişiler için protez geliştirmek amacıyla kullanılabileceğine inanıyor. Ayrıca Alzheimer hastalığı gibi hafıza bozuklukları olan kişilere yardımcı olmak için de kullanılabilir.

Devamını oku: